Ahora Google adapta automáticamente el tamaño del texto a la distancia desde la pantalla

Para desarrollar aplicaciones divertidas, Google está mejorando su inteligencia artificial relacionada con el seguimiento del iris. Un proceso que también permite adaptar el tamaño del texto en tiempo real según la distancia del usuario.

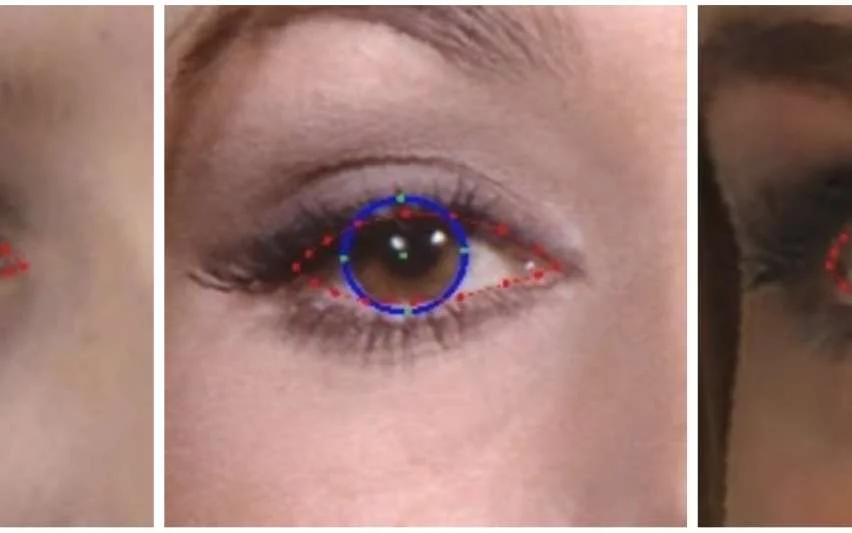

Seguir a la pupila del usuario en tiempo real para aplicar efectos en realidad aumentada o adaptar automáticamente la pantalla a su vista según su distancia a la pantalla, este es uno de los trabajos que realiza Google en torno a la Inteligencia artificial. El concepto se denominó MediaPipe Iris y los resultados se publican en el blog de IA de la empresa.

Además de poder rastrear la posición del iris al instante, los desarrolladores que trabajan en este tema explican que, con su método, consiguen determinar la distancia entre la cámara y el ojo del usuario, sin siquiera explotar un posible sensor de profundidad. Esto no parece mucho ya que los servicios de mensajería de las redes sociales ofrecen muchos stickers animados en realidad aumentada que están incrustados en tiempo real. Si el efecto lúdico es un farol, en casi todos los casos las dimensiones no son las adecuadas y hay rezagos.

En el caso de MediaPipe Iris, Google busca precisión con un mínimo de equipamiento, es decir, un simple fotosensor RGB sin sistema de lectura en profundidad. El sistema utiliza puntos de referencia en el iris que se esforzará por seguir y analizar. Para evaluar las proporciones, la IA se basa en el diámetro del iris del ojo humano. Esto es aproximadamente 11,7 mm con un margen de más o menos 0,5 mm para la mayoría de la población.

Sin necesidad de sensor de profundidad

Este método permite determinar la distancia métrica entre el sujeto y la cámara con un error relativo de menos del 10%. Por el momento, la tasa de error es mayor para los usuarios de gafas.

El trabajo realizado es una extensión de lo que ya había conseguido Google con MediaPipe Face Mesh, un sistema capaz de modelar el rostro en 3D en tiempo real sin ningún equipo especial que no sea un solo sensor RGB.

En su publicación, a Google le gustaría señalar que el seguimiento del iris no permite inferir dónde miran las personas y que no participa en el reconocimiento de identidad. El sistema está diseñado sobre todo para desarrollar aplicaciones divertidas o prácticas, como adaptar automáticamente el tamaño de los personajes a la distancia de la pantalla. Puede funcionar en la mayoría de teléfonos móviles, computadoras e incluso a través de un navegador web.

Deja una respuesta